Treffen KI-Systeme falsche medizinische Diagnosen oder diskriminierende Entscheidungen, lassen sich diese Risiken nicht immer technisch vollständig kontrollieren. Wirksame menschliche Aufsicht ist daher ein zentraler Baustein für den vertrauenswürdigen Einsatz von KI und wird für besonders risikoreiche Systeme von der Europäischen KI-Verordnung zwingend verlangt. Mit diesen Fragen beschäftigte sich das Dagstuhl-Seminar „Challenges of Human Oversight: Achieving Human Control of AI-Based Systems“auf Schloss Dagstuhl. Eingeladen waren internationale Expertinnen und Experten aus Informatik, Psychologie, Recht, Ethik, Kognitionswissenschaften und Technikgestaltung.

Begriffe wie Human-in-the-Loop oder menschliche Aufsicht sind mittlerweile feste Bestandteile politischer Diskurse zu KI. Dennoch fehlt bislang ein konsistentes, interdisziplinäres Verständnis davon, wie menschliche Aufsicht von KI theoretisch gefasst, praktisch umgesetzt, technisch implementiert und empirisch bewertet werden kann.

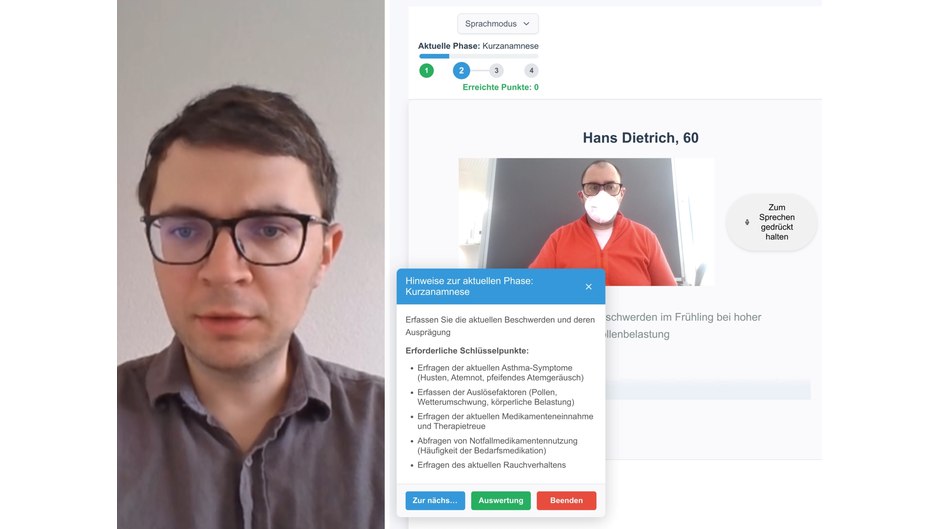

Besonders deutlich wird die Herausforderung in der medizinischen Diagnostik, wenn KI-Systeme Befunde vorschlagen: Zwar verspricht deren Einsatz eine höhere Effizienz, doch es besteht die Gefahr, dass beispielsweise bestimmte Bevölkerungsgruppen systematisch benachteiligt werden – etwa durch verzerrte Trainingsdaten – und dass Ärztinnen und Ärzte sich zu sehr auf automatisierte Vorschläge verlassen. Gerade bei unauffälligen Befunden wird eine tiefere selbstständige Beschäftigung mit Patienten und vorliegenden Daten womöglich vernachlässigt.

Von der Forderung zur Umsetzung

Oberflächlich scheint hier menschliche Aufsicht gewährleistet: Schließlich trifft letztlich eine Ärztin oder ein Arzt die Diagnose. Doch das greift zu kurz. Entscheidend ist, ob diese Person tatsächlich bereit und in der Lage ist, die KI-Ergebnisse kritisch zu prüfen, Risiken zu erkennen und bei Bedarf den zusätzlichen Aufwand auf sich zu nehmen, korrigierend einzugreifen. In der ärztlichen Praxis fällt die Rolle der medizinischen Fachkraft oft mit der der KI-Aufsichtsperson zusammen. Menschliche Aufsicht ist eine von mehreren Anforderungen der KI-Verordnung für Hochrisiko-KI-Systeme. Sie fungiert als Auffangnetz: Risiken, die sich technisch nicht vollständig ausschließen lassen, sollen vom Menschen kontrolliert und minimiert werden.

Wesentliche Expertise wurde bereitgestellt von überregionalen Forschungsinitiativen, darunter der transregionale Sonderforschungsbereich 248 „Center for Perspicuous Computing“ (CPEC) der DFG sowie dem „Center for European Research for Trusted AI” (CERTAIN), einer Initiative des Deutschen Forschungszentrums für Künstliche Intelligenz (DFKI). Ansprechpartner sind hier Raimund Dachselt (CPEC, TU Dresden) und Kevin Baum (CERTAIN, DFKI). Die Teilnehmer des Seminars waren sich einig: Effektive menschliche Aufsicht ist möglich, aber keineswegs trivial. Sie erfordert mehr als gute Absichten oder das Hinzufügen menschlicher Beteiligung an beliebiger Stelle im Entscheidungsprozess. Stattdessen werden systematische Verfahren zur Entwicklung von KI-Systemen, zusätzliche Werkzeuge, interdisziplinäre Zusammenarbeit, und konkrete Umsetzungsstrategien benötigt.

Foto: Adobe Stock / grey